使用到的软件

- Python集成开发环境:miniconda

- CUDA、cuDNN:英伟达提供的针对英伟达显卡的运算平台。用来提升神经网络的运行效率,如果电脑显卡不满足要求也是可以不用安装,使用cpu来进行运算。

- 深度学习库:PyTorch

- 开发工具:VSCode

安装步骤

miniconda

Miniconda 是轻量级 conda 发行版,只含 conda、Python 和基础依赖,极小安装包、跨平台、能创建隔离环境、按需装包,安装miniconda即可,不需要安装完整的Anaconda。

Conda 是一个跨平台的环境管理器 + 包管理器。就相当于一个可以帮厨师创建不同的锅防止菜串味的工具+菜市场

下载miniconda

点击网址进入下载页面,或者点击[此处]下载,当然也可以通过镜像站下载

安装miniconda

注意:更改目录的时候一定要放在空的文件夹,而且路径中不能有中文和空格包括

program files中的空格,否则会报错。此处建议勾选1 3 4选项,如果你安装过python就不用勾第三个

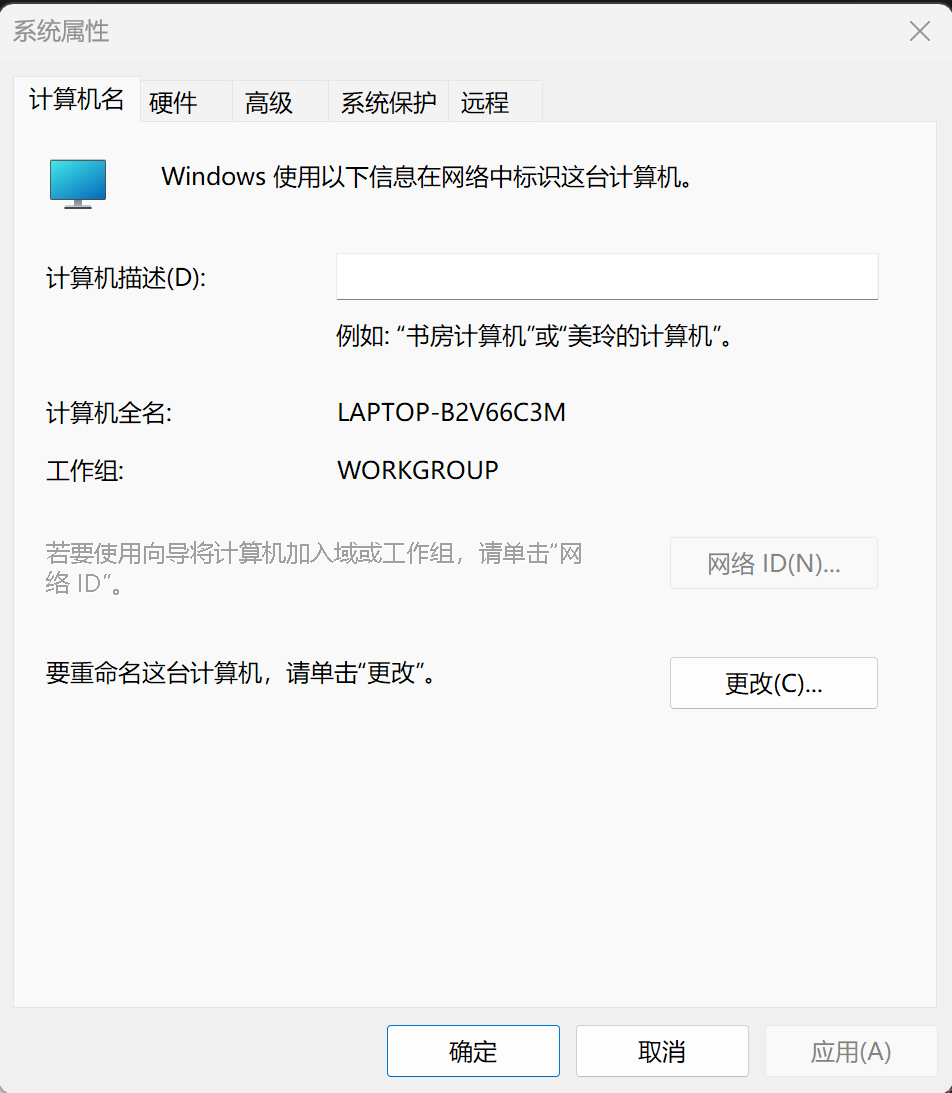

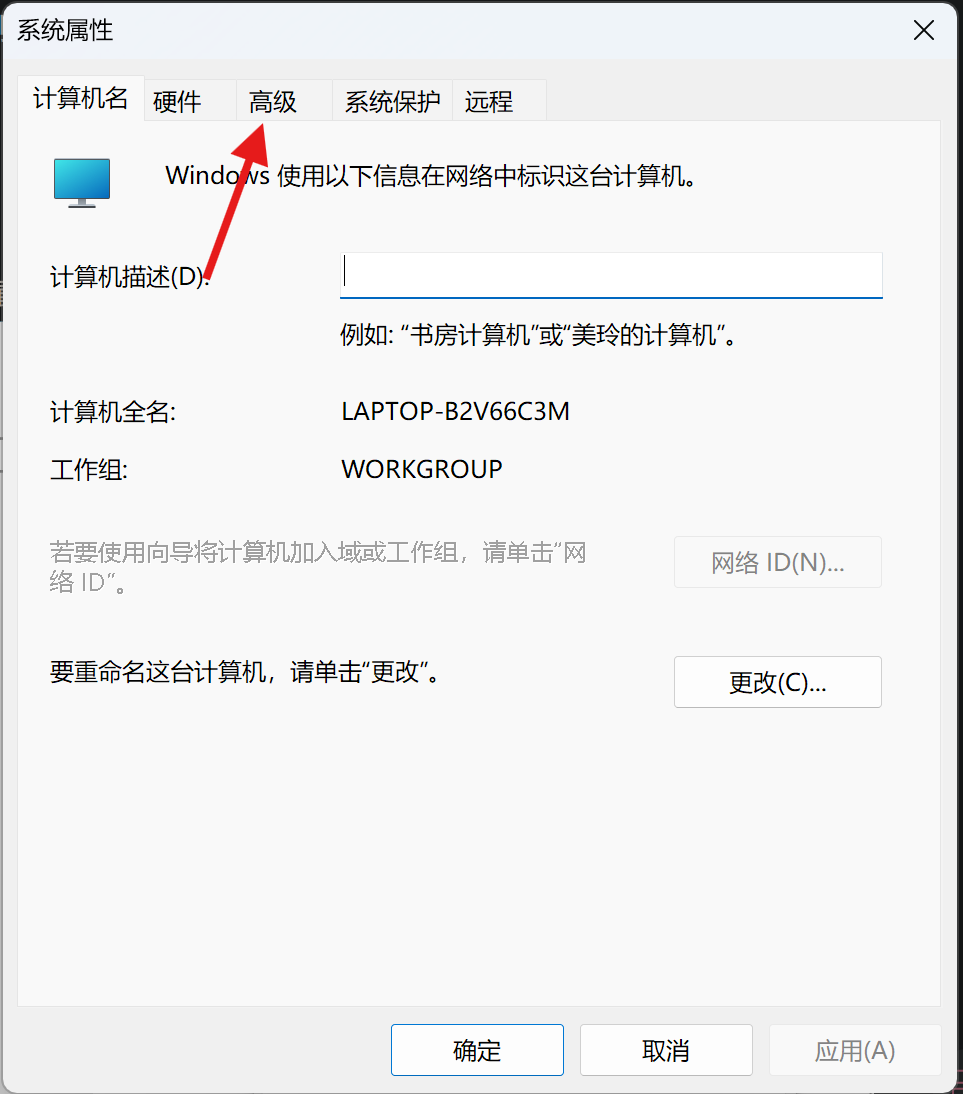

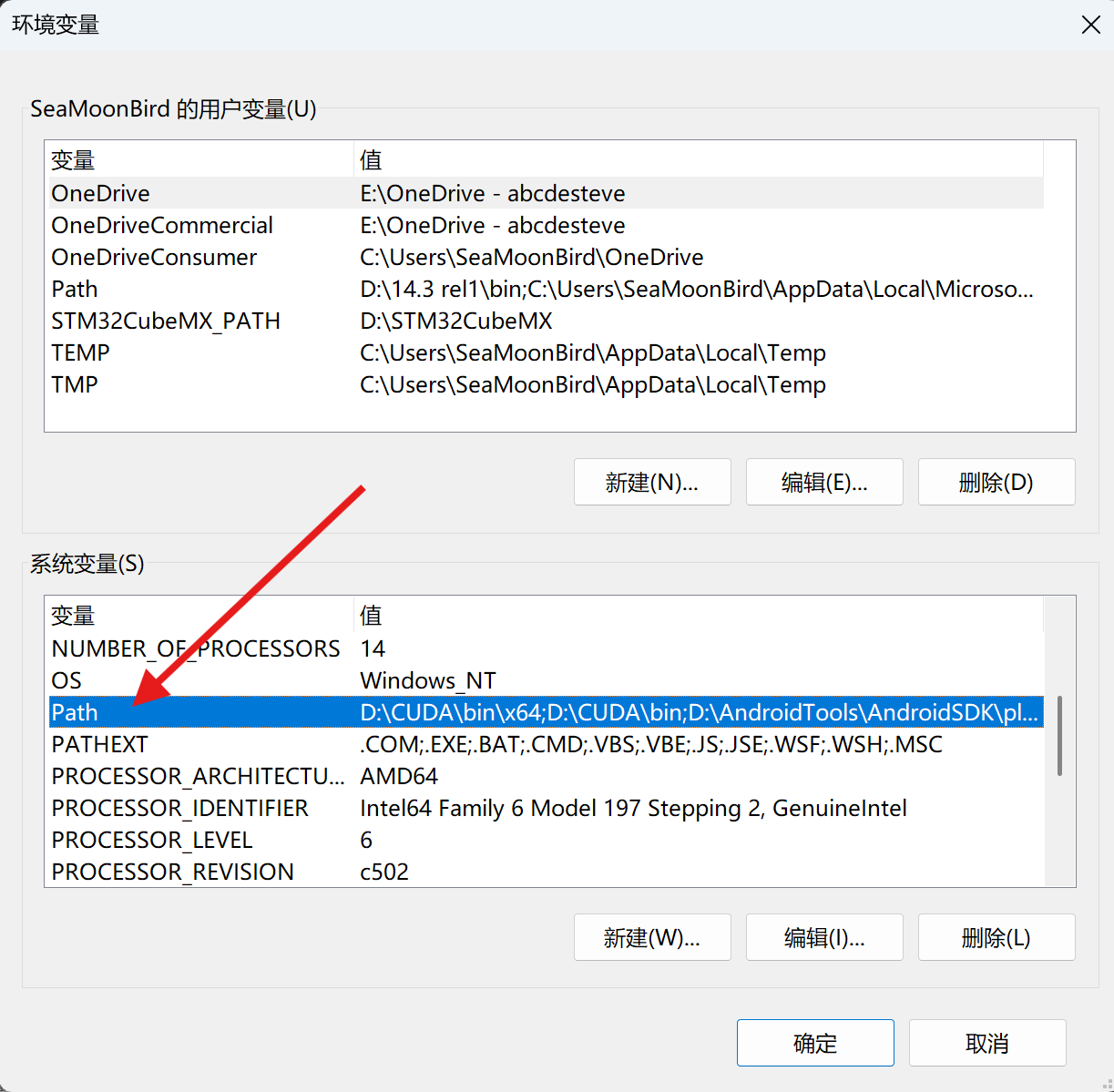

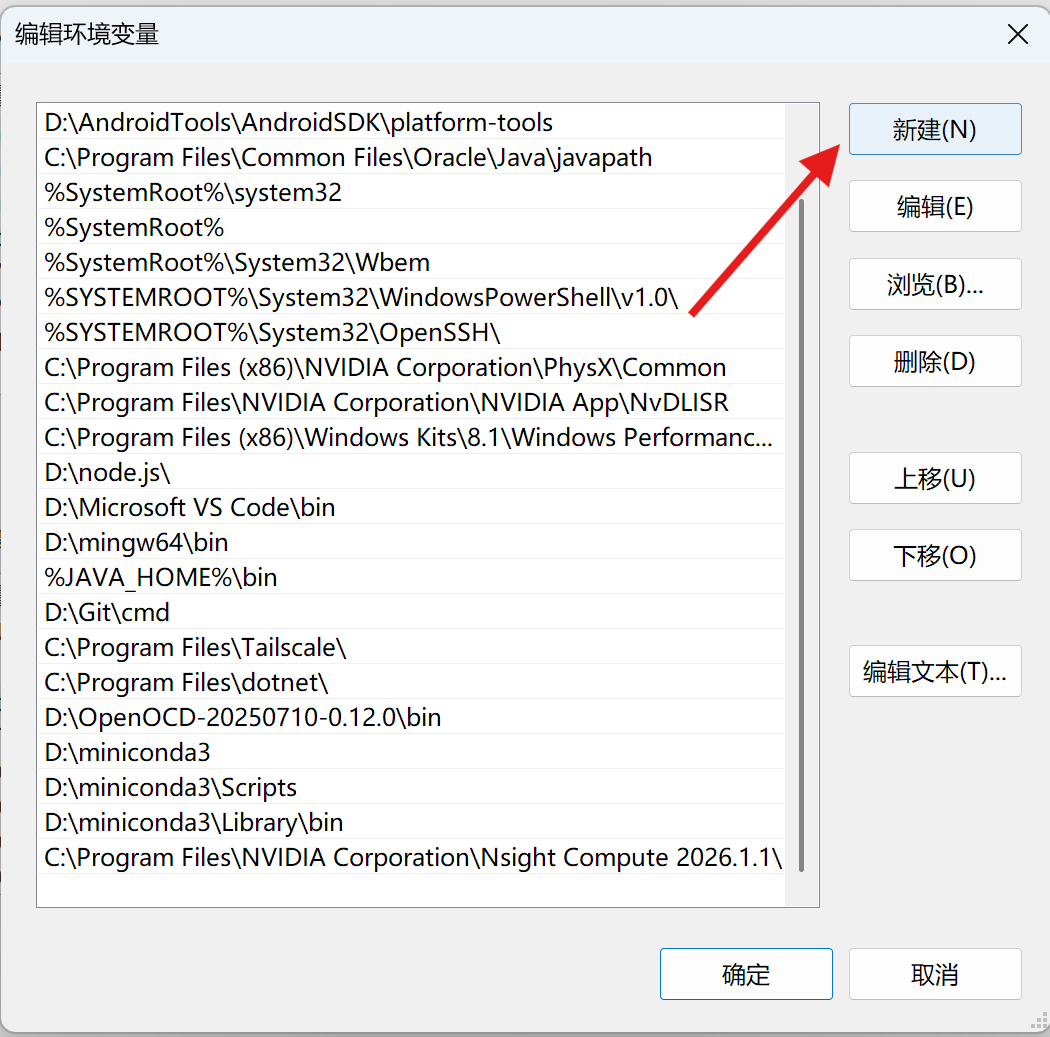

添加环境变量

win+r调出运行窗口,输入sysdm.cpl,依次点击"高级","环境变量",双击"系统变量"中的"Path",点击"添加",将以下几个环境变量添加进去。

D:\miniconda_env_pkg

D:\miniconda_env_pkg\Scripts

D:\miniconda_env_pkg\Library\mingw-w64\bin

D:\miniconda_env_pkg\Library\bin**注意:,我因为将miniconda安装在了D:\miniconda_env_pkg,所以我的路径才是这个,需要根据实际情况找到这几个文件夹,做调整后再加进去。例如:你把Anaconda安装到了E盘中名为Python的文件夹,那么你的格式为E:\Python\Library\mingw-w64\bin其余三个类同,只需修改前面的内容即可。

测试安装是否成功

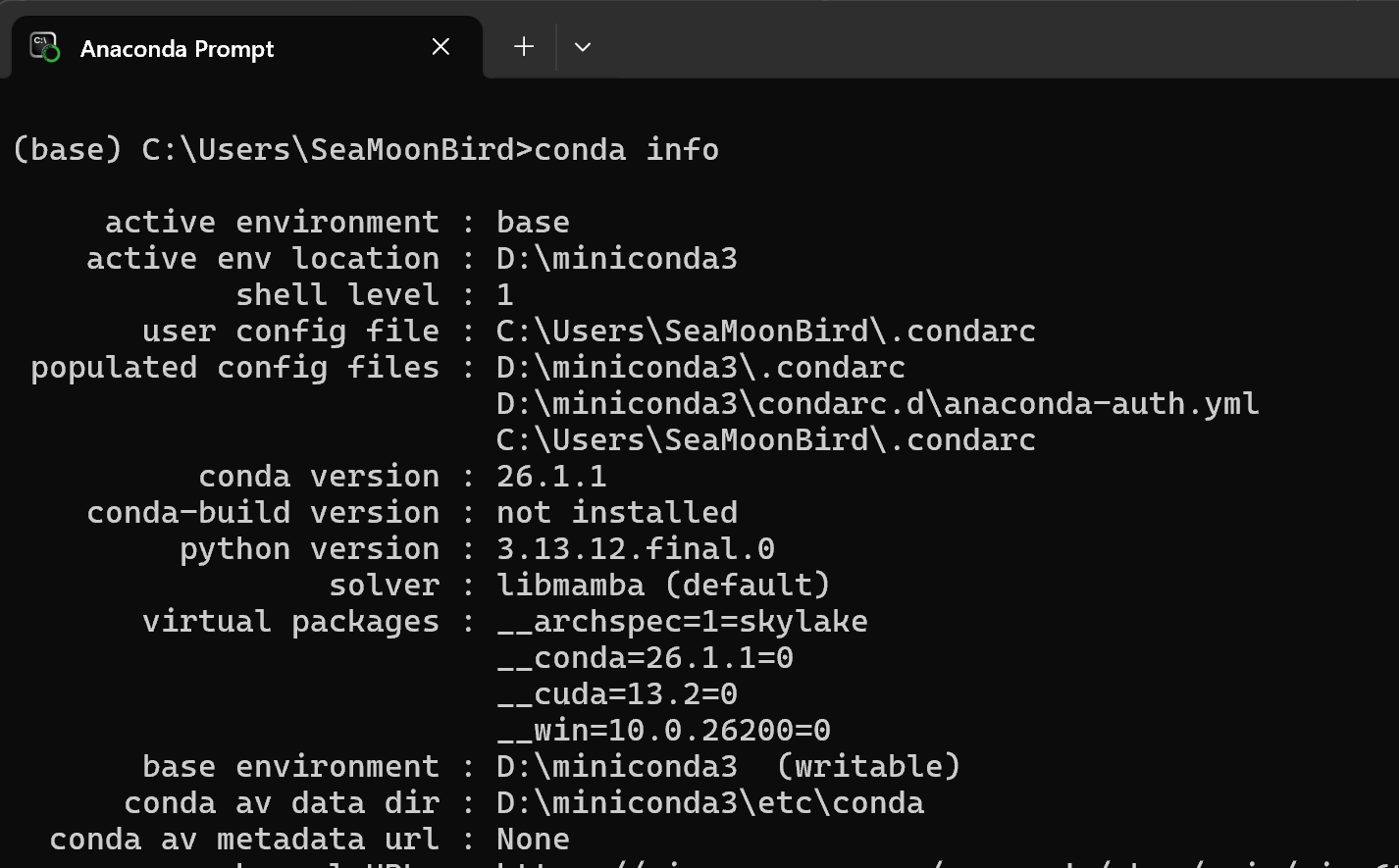

- 点击

win搜索Anaconda Prompt,打开。 - 会弹出一个命令行窗口,在里面输入

conda info。

应该会输出类似如下:photo 加载中

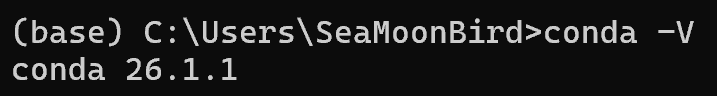

再输入

conda -V查看版本号

应该会输出类似如下:photo 加载中

如果输出

conda不是内部或外部命令那就意味着,anaconda没有配置好环境变量。重新配置以下环境变量

更换conda源

换源说明:

前面提到过,conda就是个巨大的菜市场,但是国内访问速度较慢,可以更换使用镜像站提升速度。

- 如果是在学校,可以看看自己学校有没有镜像站,有的话用校园网会很快,比如我是用的是本校的OSA镜像站。

- 如果不在校园或者学校没有镜像站,那么就使用

中科大源或者清华源等。

换源步骤:

还是利用上一步的方法打开

Anaconda Prompt,输入命令以### 创建.condarc文件(配置文件)conda config --set show_channel_urls yes- 在C盘的用户文件夹目录下面找到.condarc文件,用记事本打开

不管你把miniconda装在了哪一个盘,都是在这个目录里面找

如果你安装了VSCode,那么就可以输入命令code .condarc直接用VSCode打开并进行编辑 在文件中输入

channels: - defaults show_channel_urls: true default_channels: - https://mirrors.osa.moe/anaconda/pkgs/main - https://mirrors.osa.moe/anaconda/pkgs/r - https://mirrors.osa.moe/anaconda/pkgs/msys2 custom_channels: conda-forge: https://mirrors.osa.moe/anaconda/cloud pytorch: https://mirrors.osa.moe/anaconda/cloud如果是其他镜像站,可以在他们的镜像站里面的使用教程找到命令,比如 清华大学开源软件镜像站 就写

channels: - defaults show_channel_urls: true default_channels: - https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/main - https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/r - https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/msys2 custom_channels: conda-forge: https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud pytorch: https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud使用下列命令清除索引缓存,并安装常用包测试一下。

conda clean -i conda create -n myenv numpy

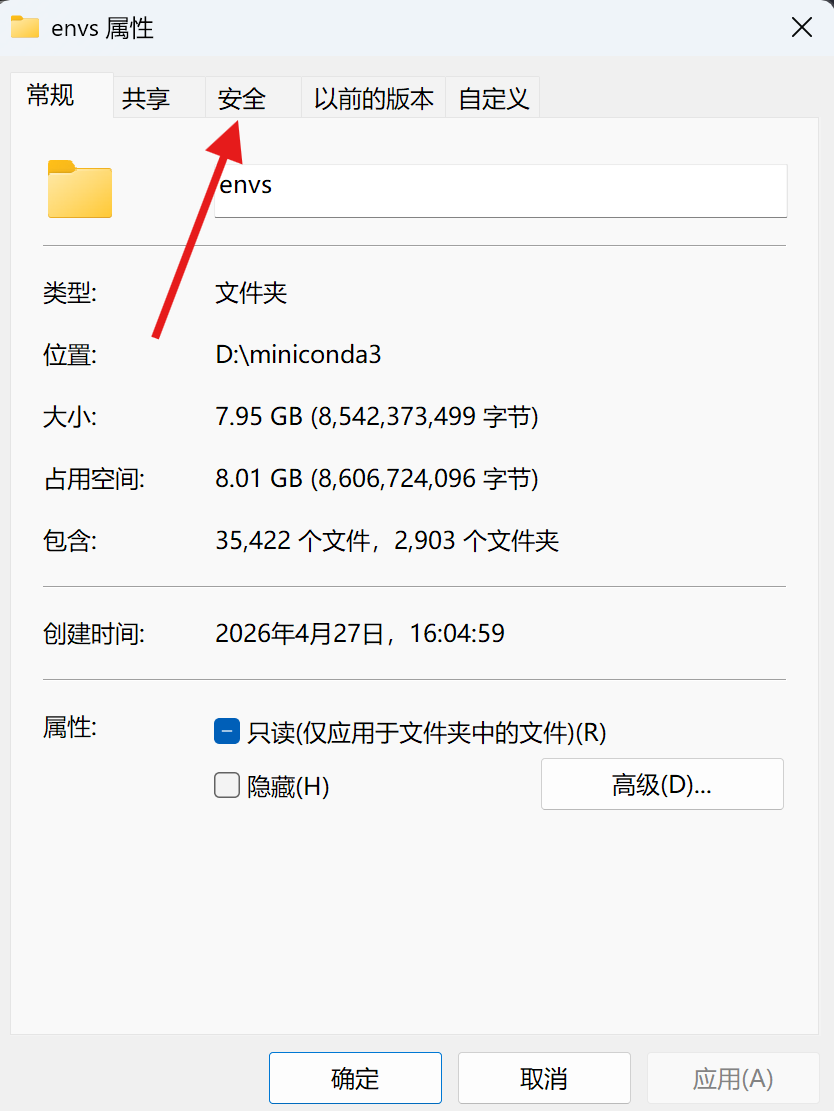

更改虚拟环境存放路径

还是打开刚才的

.condarc文件,在最后添加envs_dirs: - D:\Miniconda3\envs pkgs_dirs: - D:\Miniconda3\pkgs这里面的

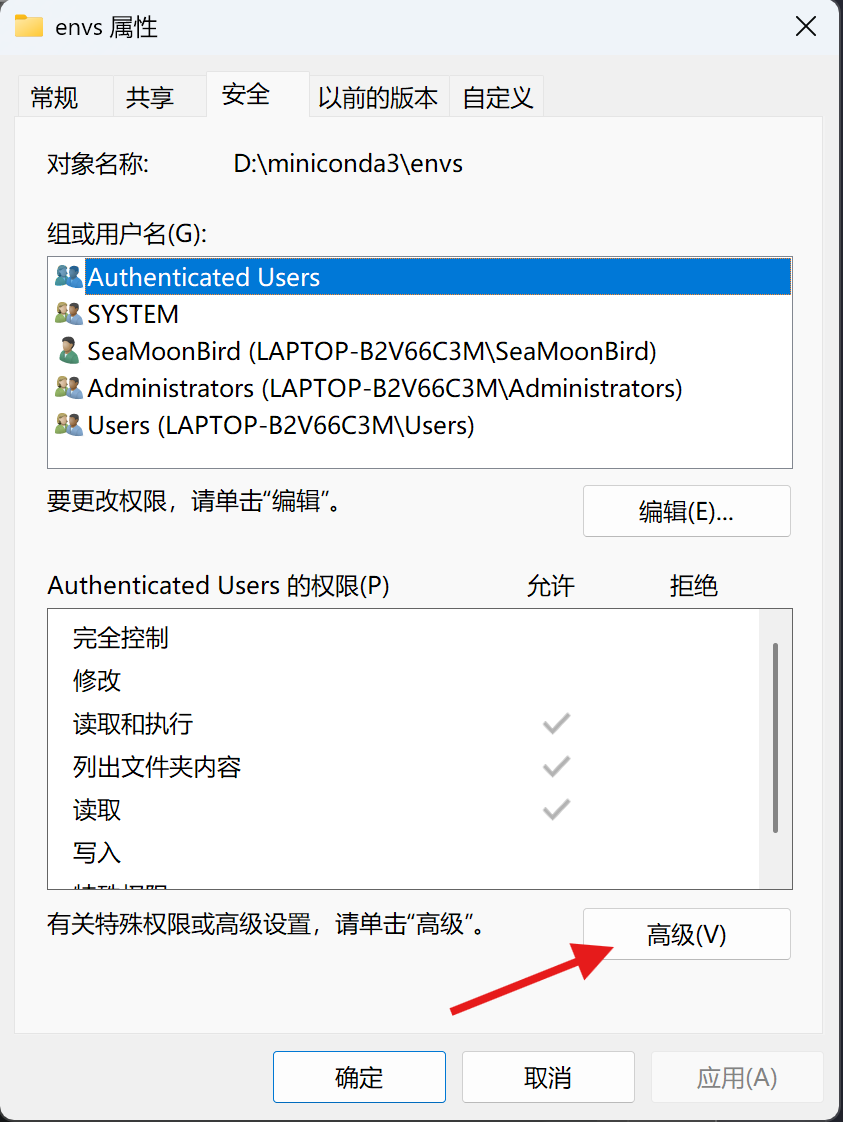

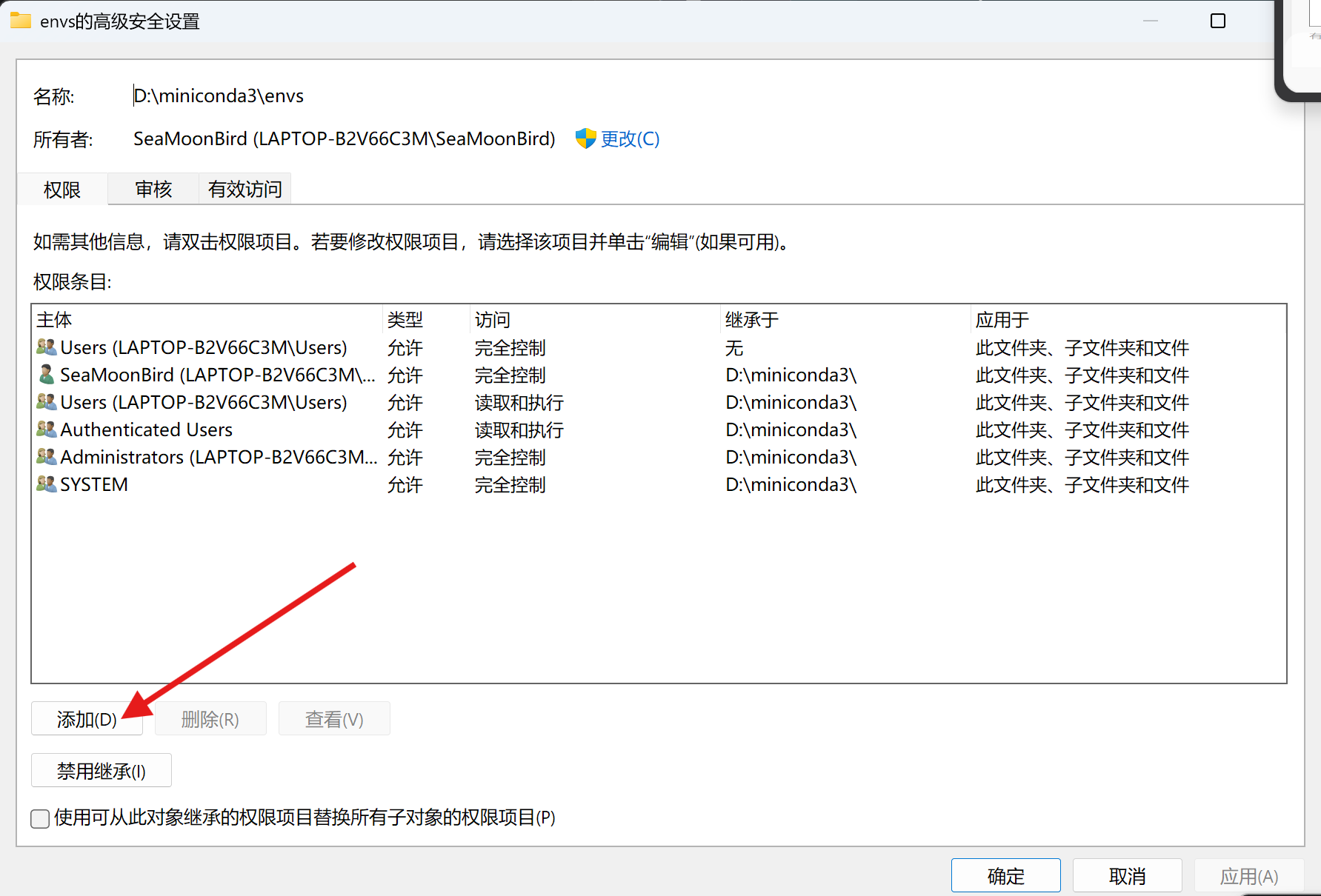

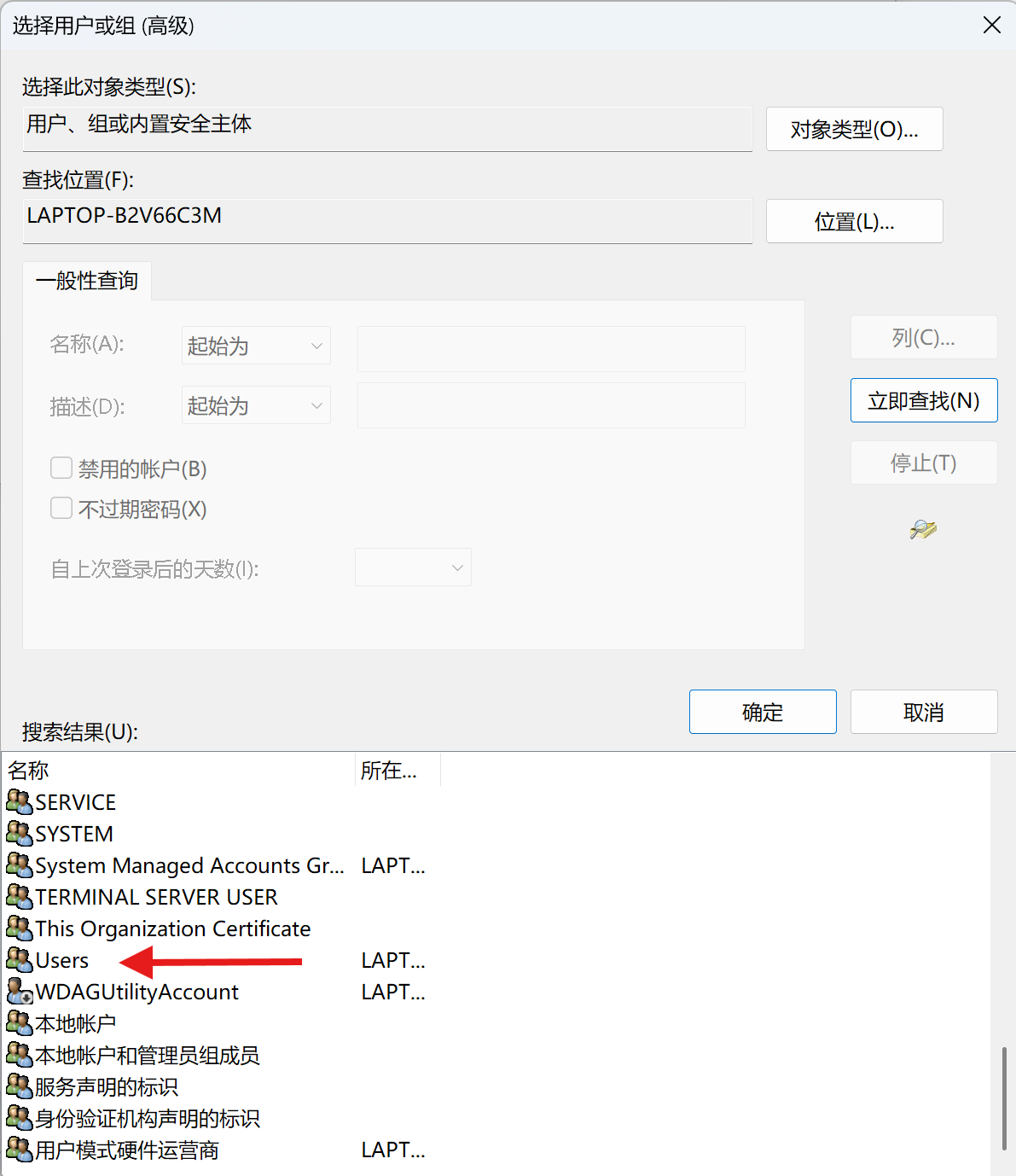

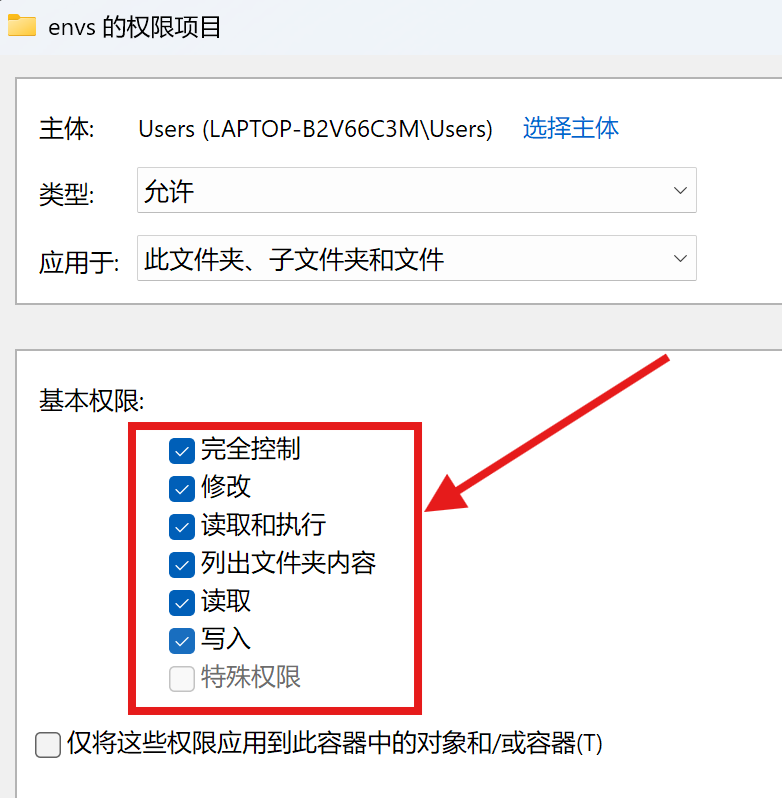

D:\Miniconda是你安装miniconda的路径,如果里面没有envs的文件夹,那么就创建一个文件夹并修改文件夹权限。右键文件夹,点击“属性”,点击“安全”,点击“高级”,点击“选择主体”,点击“高级”,点击“立即查找”,选择Users,再勾选所有权限的选项,即可。photo 加载中 photo 加载中

photo 加载中 photo 加载中

photo 加载中 photo 加载中

photo 加载中 photo 加载中

photo 加载中 photo 加载中

photo 加载中 photo 加载中

photo 加载中 photo 加载中

photo 加载中 photo 加载中

photo 加载中

然后一路点确定即可。pkg文件夹同理

更新NVIDIA显卡驱动

- 点击托盘,打开NVIDIA驱动程序

- 点击左侧的驱动程序,再在右上角点击studio驱动程序,更新

安装CUDA

- 在终端输入

nvidia-smi,查看自己的CUDA版本,如图所示

右上角有CUDA版本号,去官网下载CUDA并安装,下载的CUDA不可高于输出的版本号,也最好不要过低。 - 在终端输入

nvcc -V查看是否安装成功

安装cuDNN

根据CUDA版本去官网下载对应的cudnn并进行安装,一般9.2.x对应的CUDA版本就是12.x/13.x

创建、激活虚拟环境

创建

在Anaconda prompt里面输入conda create -n xxx python=3.9 #xxx是你自己给这个环境取的名字即可创建一个带有3.9版本的python的虚拟环境.建议python版本不要选太高,否则可能出现安装labelimg(标注工具)的时候由于python版本太高,导致自动安装的pyqt5版本太高,高版本的pyqt5接受整型数据,而labelimg发出浮点型数据,最终导致闪退的尴尬现象

别问我怎么知道的激活

在命令行中输入conda activate xxx完成改步骤后会在命令行的前面出现(xxx),若出现(base)则是没有成功激活。

安装带有CUDA库的PyTorch

打开官网,选择自己适合的版本,复制图中的命令行,然后输进刚才的命令行。一定要在xxx环境中

下载速度取决于网络情况

验证方法:

在命令行中输入python

然后依次输入以下命令import torchprint(torch.__version__) #查看pytorch版本print(torch.cuda.is_available()) #查看cuda是否可用 输出为True 或者Falseprint(torch.backends.cudnn.version()) #查看cudnn是否可用,输出为版本号

安装Labelimg标注工具

在刚才的命令行以及环境中输入以下命令

pip install PyQt5 pyqt5-tools lxml labelImg安装并验证YOLO

在刚才的命令行及环境中输入

pip install ultralytics下载速度取决于网络情况

输入

pip show ultralytics

VSCode的配置

- 打开VSCode

- 打开一个你要训练模型的目录,新建一个python程序,空白的就行。

右下角选择环境与解释器注意,要选两次,一次是选解释器,一次是选环境

如果这一步出现不能使用脚本之类的提示,那就要以管理员身份打开终端,输入下面的命令以临时放宽权限Set-ExecutionPolicy RemoteSigned -Scope CurrentUser如果出现要进行

conda init的提示,那就输入这条命令

使用步骤

数据集结构说明

data/

├── train/ # 训练集

│ ├── images/ # 其他场景图片

│ └── labels/ #放打出来的标注

│

├── val/ # 验证集 要求不能与训练集重复

│ ├── images/

│ └── labels/

│

└── test/ # 测试集 测试效果的,也不能与训练集、验证集重复

└── images/使用Labelimg

- 点击 Open Dir,选择

train/images或者val/images图片文件夹 - 点击 Change Save Dir,选择

train/labels或者val/labels标签保存文件夹 - 左上角切换标注格式:Pascal VOC 改为 YOLO

开启自动保存(再也不用 Ctrl+S)

- 顶部菜单栏点击:View

- 勾选 Auto Save mode

常用快捷键

W:开始绘制标注框A:上一张图片D:下一张图片(自动保存)Del:删除选中的标注框

标签文件说明

每张图片会生成同名.txt标签,为 YOLO 标准格式:类别ID 归一化中心x 归一化中心y 归一化宽度 归一化高度

初体验YOLO

在VSCode的终端中输入

yolo predict model=yolo11n.pt source=https://ultralytics.com/images/bus.jpg save=True下载速度取决于网络情况

然后你就可以在run/detect/predict里面看见一张识别了人、车的图片了

YOLO的训练

此步骤需要有打好标签的数据集,且确保进入环境

yolo简述

yolo 有四种运行模式、四种任务模式

四大任务模式

- Detect 目标检测(最常用)

- Segment 语义分割

- Classify 图像分类

- Pose 姿态估计

YOLO 四种运行模式(动作)

- predict 推理预测(日常跑图、跑视频、摄像头)

- train 训练(自己数据集炼丹)

- val 验证(看模型精度 mAP、准确率)

- export 导出模型(转 ONNX/TensorRT/onnxruntime 部署)

训练模型

新建一个

data.yaml配置文件,输入以下内容:# 训练、验证、测试集路径(用相对路径) train: ./data/train/images val: ./data/val/images test: ./data/test/images # 没有测试集可以删掉这行 # 类别数和类别名 nc: 1 names: ['tactile'] # 和 classes.txt 里的类别名保持一致就行输入命令

命令模板为yolo 任务 动作 model=权重.pt source=输入 其他参数参数解释

model=xxx.pt # 选用的模型权重 source=xxx # 输入:图片/视频/摄像头/文件夹 conf=0.5 # 置信度阈值,低于0.5不显示 save=True # 保存结果 show=True # 弹出窗口实时看画面 device=0 # 用GPU 0;device=cpu 用CPU一般我们直接输入

yolo detect train model=yolo11n.pt data=data.yaml epochs=100 imgsz=640 device=0意思是用

yolo11n.pt模型进行训练,数据集按照data.yaml里面的来,训练100轮(每一轮都会在train里面找图片学习,在val里面验证),并且要求使用显卡。- 得到的结果放在

run/任务/动作-x/文件夹下,比如训练好的模型(用于目标检测)就在runs\detect\train-x\weights\best.pt - 如果出现训练到一半中止了,可以将命令中的

model=后面的改为最新的run/detect/train-x/weights/last.pt继续训练 - 如果还是不行,那就加上

batch=8 workers=0,这是减少同时训练的照片数量和减少线程

comment 评论区

star_outline 咱快来抢个沙发吧!